滿血DeepSeek-R1的極速接入方式-火山方舟

URL Source: https://mp.weixin.qq.com/s/eRr74xPL54unc7-9WIQ9pA

最近一個月被DeepSeek R1天天刷屏後,很多人離了DeepSeek怕是都難以工作了。我一直以為使用者量爆炸後,DeepSeek該離會員制不遠了,我還真就挺願意花點錢去獲得更穩定的服務的。但…看來Deepseek真是對整會員向使用者收錢這事無動於衷啊,官網和app還在天天擱這繁忙呢~

所以,我上週也已經透過影片和公眾號給大家推薦了

DeepSeek太卡了?這有5+1種DeepSeek R1最強滿血替代方案等你查收!

因為DeepSeek是開源模型,有各種雲服務廠商部署了他們的模型,透過API方式給使用者提供服務,也有一些公司把DeepSeek R1接入了自己的產品,比如我上次文章中提到的AI程式設計工具Cursor、AI搜尋產品Perplexity等。

不過,搜尋、程式設計的使用場景畢竟還是受限,大家好像都更習慣透過chatbot的方式去使用deepseek的服務,於是各種雲服務廠商引來了一波API使用使用者量的爆炸,就看誰能接住這波deepseek溢位的潑天富貴了。

這幾天關於哪家deepseek API服務商提供的服務更穩定、速度更快也是炒得好不熱鬧的。截至目前,我看到過的最公允的評測應該是「賽博禪心」公眾號發出的:

從這個評測看的話,火山和矽基流動Pro版本應該是目前最值得選擇的模型,DeepSeek官方確實還是有點拉垮,和我自己的體驗基本一致。這個評測還挺厲害的,推薦大家都可以去看看。

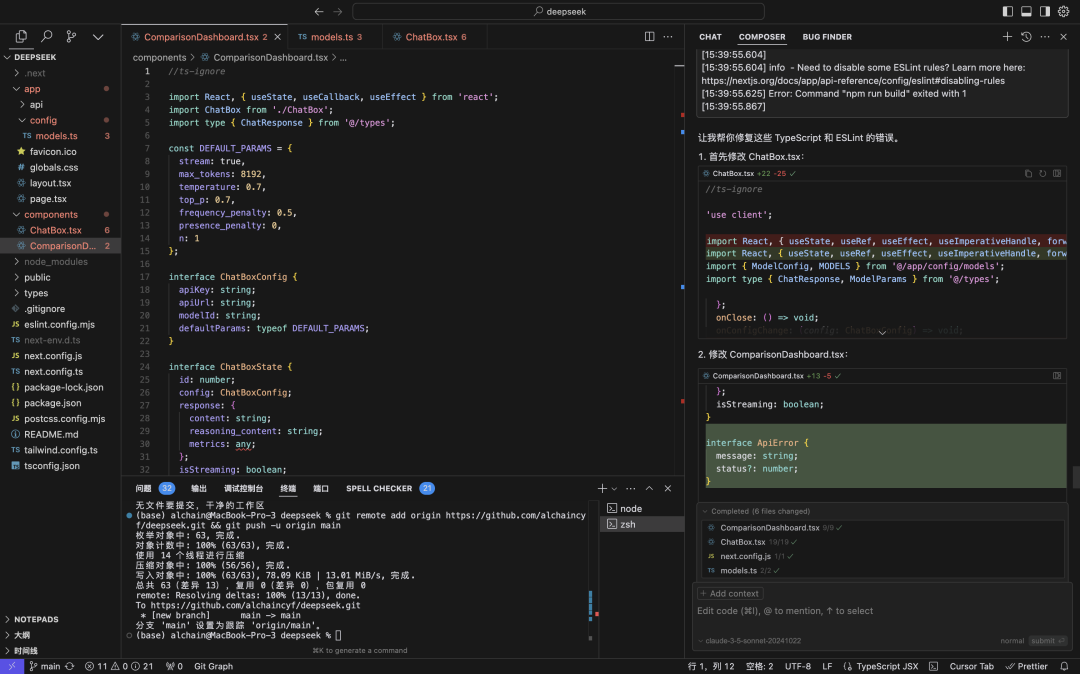

不過作為一個B站10萬粉AI up主✌️,我對評測這事有點不一樣的想法,我想試試怎麼更視覺化的展現不同API平臺的速率,而不只是看著這一串數字。於是,帶著這該死的想法,我和Cursor折騰了大半天,整出了一個視覺化評測的小工具。

我們拿兩個問題試試不同平臺的表現究竟怎麼樣👇

為了體現模型的真實速度,這兩個影片都沒有做任何加速。這兩次測試裡最拉垮的都是deepseek官方的API,都直接不給我回復了😢,三個雲廠商的API產品服務至少都算是穩定,可以持續輸出。

相對來說目前的速率情況是火山和矽基流動Pro都還挺快的:火山方舟 > 矽基流動Pro > 阿里雲百鍊 >> DeepSeek官方。

我又去位元組的火山方舟平臺看了下,一直到2月18號,火山的DeepSeek-R1和V3模型每百萬token的輸入和輸出價格分別是2元和8元,是官方價格的一半,每個使用者會有50萬的免費token額度。

火山方舟的DeepSeek R1:https://console.volcengine.com/ark/region:ark+cn-beijing/model/detail?Id=deepseek-r1

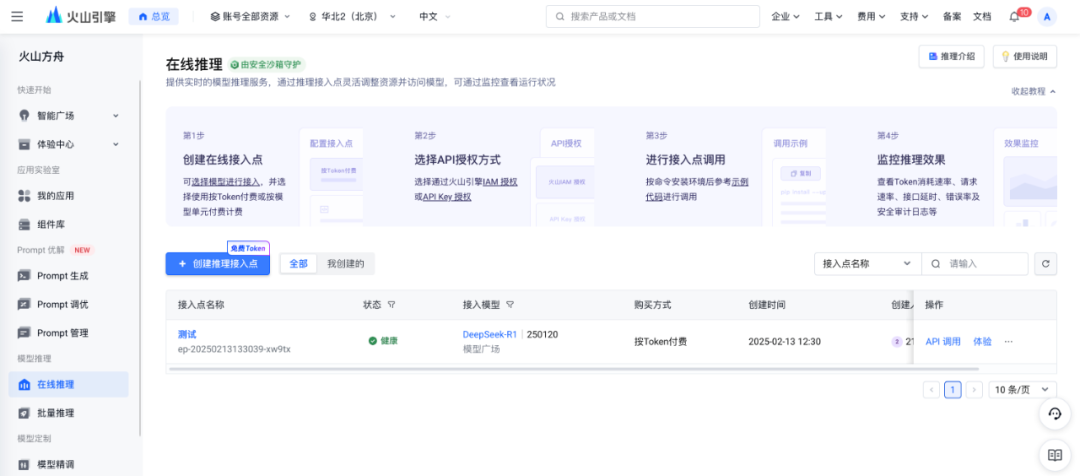

不過,有一點需要注意的是,呼叫火山方舟的deepseek模型的話你需要非常關注模型名稱model,他們的規則和別的平臺不太一樣,model名稱不是統一的DeepSeek-R1,而是你需要去建立一個自己的端點(Endpoint_id)

所以,你的操作步驟應該是:

1、到這個介面建立端點

https://console.volcengine.com/ark/region:ark+cn-beijing/endpoint

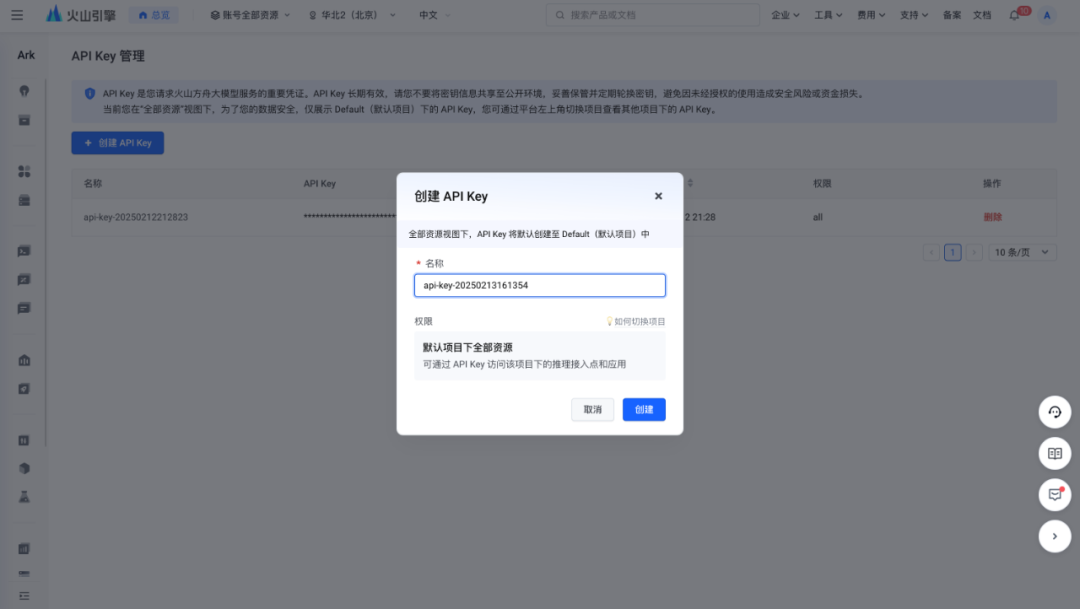

2、到這個介面建立API Key

https://console.volcengine.com/ark/region:ark+cn-beijing/apiKey

3、去對應的套殼產品填入API key和模型端點資訊

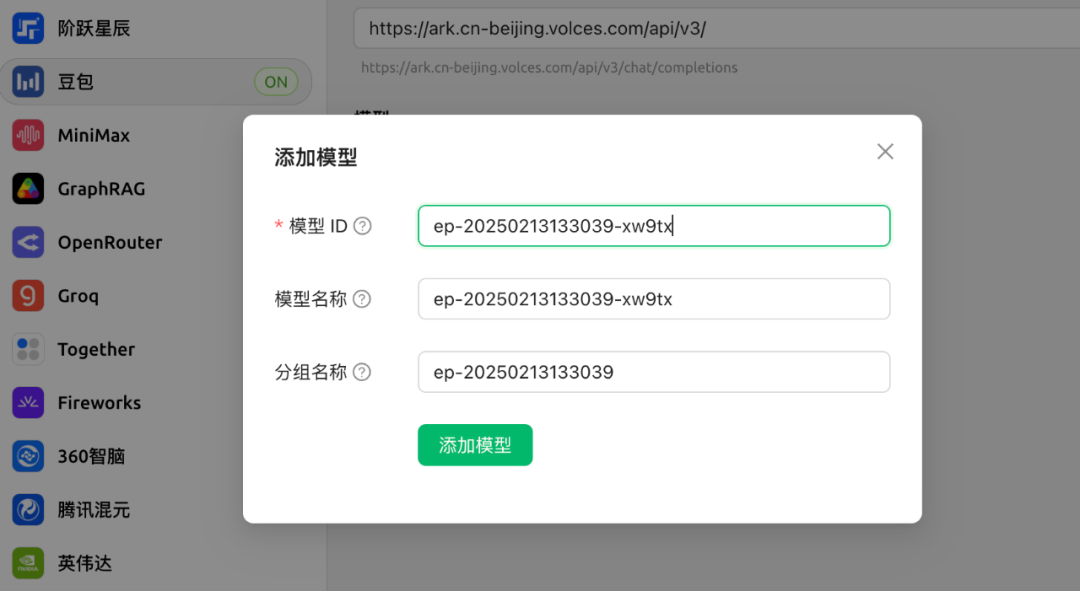

以CherryStudio為例的話,你需要在設定裡找到「豆包」,然後在這個介面你除了需要輸入API key之外,還要注意點選“新增”,把你在第1步獲取��的端點資訊填寫進去。

我們來感受下聊天過程有多絲滑👇